Не только рекламодателей Facebook «сводит с ума» строгими ограничениями и банами. Обычные пользователи, которые хотят пообщаться с друзьями и родственниками, сталкиваются с несовершенствами соцсети. Проблемы самые разные: алгоритмы продвигают контент, разжигающий ненависть, а разработчики пренебрегают этикой ради прибыли.

Ещё больше обвинений в сторону Facebook посыпалось после того, как The Wall Street Journal опубликовало расследование the Facebook Files, где подробно описаны проблемы соцсети. В основу материала легли документы, предоставленные бывшей сотрудницей компании Фрэнсис Хауген. Вместе с ZorbasMedia анализируем, как Facebook портит жизнь компании, сотрудникам и пользователям.

Ненависть и противоречивый контент как источники дохода

В 2018 году Facebook обновил алгоритмы новостной ленты. По задумке разработчиков, улучшенные алгоритмы должны были оптимизировать выдачу публикаций так, чтобы в топе оказывались записи, которые набрали наибольшее количество реакций.

На практике выяснилось, что негатив лучше всего привлекает внимание реакциями: «Angry» и «Sad». Иными словами, гнев и уныние продвигают публикацию активнее, чем нейтральный «Лайк». Так, в новостной ленте стал преобладать контент, который вызывает отрицательные эмоции и провоцирует агрессию в социальной сети.

По внутренним исследованиям Facebook, записи, которые вызывают ненависть и разногласия, больше вовлекают и удерживают людей, заставляя их проводить больше времени в онлайне. Несмотря на то, что новостная лента стала превращаться в токсичную и агрессивную среду, Facebook решил не менять алгоритм. Ведь в таком случае люди станут проводить меньше времени на сайте, из-за чего компания будет зарабатывать меньше. Так, агрессия и неоднозначный контент стали источниками дохода для Facebook.

Все пользователи равны (но некоторые равнее)

В результате расследования The Facebook Files выяснилось, что компания создала систему XCheck, которая даёт привилегии известным людям. Так, на VIP-пользователей Facebook не распространяются правила модерации контента, поэтому они могут публиковать даже те записи, которые нарушают стандарты соцсети.

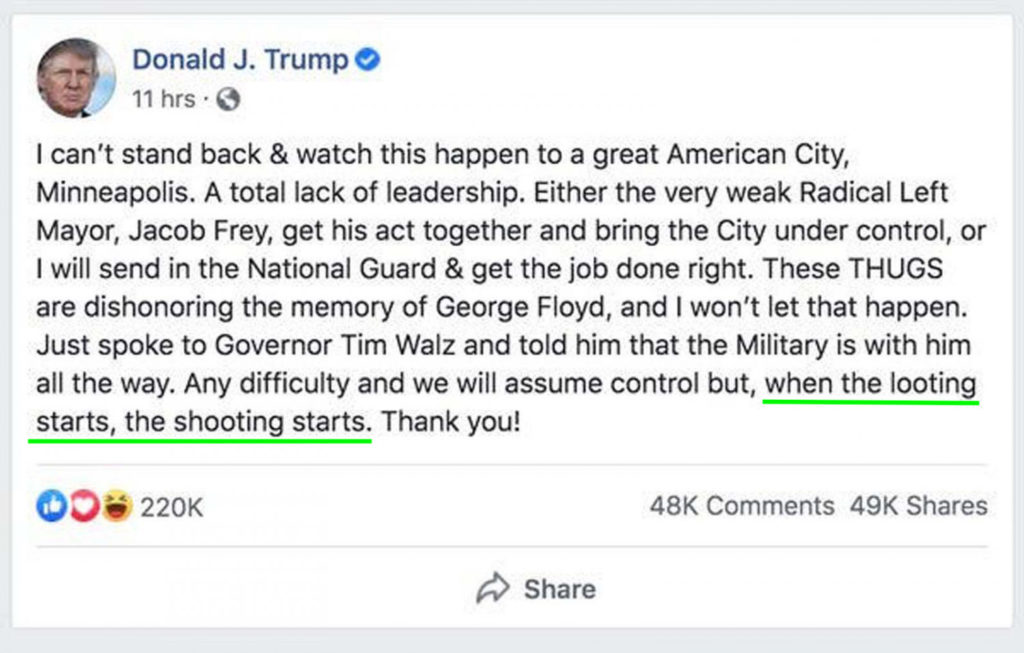

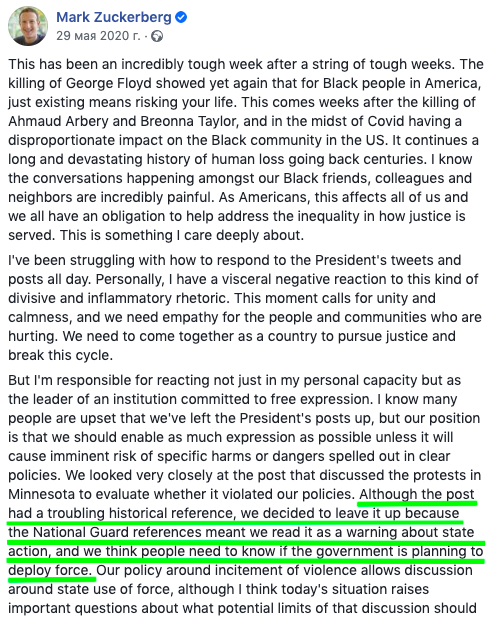

Примером является пост бывшего президента США Дональда Трампа. В мае 2020 года, во время беспорядков из-за убийства Джорджа Флойда, Трамп сделал публикацию, со словами «Когда начинается грабеж, начинается стрельба». Это цитата бывшего начальника полиции Майами, известного жестокими репрессиями против чернокожих протестующих в 1960-х годах.

Система модерирования Facebook отметила, что запись с высокой вероятностью нарушает принципы компании, однако публикацию не удалили. Марк Цукерберг обосновал это тем, что людям нужно знать о потенциальных действиях государства.

У пользователей из «белого списка» есть ещё одна привилегия. Если модераторы Facebook решают, что контент всё же нарушает правило соцсети, они не блокируют его, а предлагают VIP-пользователям удалить пост самостоятельно в течение 24 часов.

Во внутренних отчётах Facebook говорится, что компания считает критику программы XCheck справедливой и работает над её оптимизацией.

Онлайн-офис для преступников

Даже внутри Facebook признают, что модерация — это слабое место соцсети. На Ближнем Востоке Facebook использовался как площадка для торговли людьми, а в Эфиопии — для подстрекания к насилию в отношении этнических меньшинств.

Дело в том, что в компании не хватает иностранных специалистов. Они могли бы анализировать посты неанглоязычных пользователей и вовремя удалять записи, если в них есть признаки криминальной деятельности. А пока публикации преступников, призывающие к вражде и ненависти, становятся вирусными и распространяются на Facebook до того, как их заблокируют.

В 2018 году в Facebook обнаружили более тысячи публикаций, разжигающих ненависть к народу Рохинджа в Мьянме и призывающих выгонять его с территории государства. Журналисты Reuters опубликовали расследование, в котором сообщали, что Facebook не сразу смог распознать посты, потому что в компании был только один модератор, владеющий бирманским языком.

Facebook со своей стороны уверяет, что делает всё возможное для проверки данных и обеспечения безопасности пользователей. Однако эти утверждения не подкреплены документами и отчётами о конкретных действиях, поэтому гарантий в том, что соцсеть действительно оптимизирует модерацию, нет.

Манипуляция эмоциями и Facebook-зависимость

Социальные сети борются за внимание пользователей, и Facebook — не исключение. Бесконечная лента новостей, возможность разнообразных реакций — эти функции изначально создавались для того, чтобы заинтересовать людей, но в результате пользователи стали зависимы от Facebook. Правда, на данный момент компании не выгодно что-то менять: существующая бизнес-модель приносит доход.

Facebook обвиняют в том, что соцсеть скрывала данные внутреннего исследования о негативном влиянии Instagram, боясь потерять прибыль. С 2019 по 2021 год в компании изучали, как Instagram влияет на психику подростков. Специалисты из области анализа данных, маркетинга и психологии проводили опрос среди подростков, а затем анализировали ответы. The Wall Street Journal ссылается на пять презентаций с результатами исследований, согласно которым 32% опрошенных девочек-подростков сказали, что Instagram провоцировал переживания по поводу фигуры. Около 13% подростков из Великобритании и 6% из США признались, что Instagram наводит на мысли о суициде. При этом пользователи отмечали, что чувствуют себя зависимыми, но не могут контролировать время, которое они проводят в соцсети.

Facebook «охотится» на эмоции пользователей, стимулируя их потреблять как можно больше контента, чтобы дольше оставаться в онлайне. Рассказывая о технических проблемах Facebook, мы уже упомянули о том, что противоречивый, шокирующий контент лучше вовлекает людей. Этой особенностью человеческой психики пользуется соцсеть.

В 2012 году Facebook провел эксперимент, протестировав эмоции 700 000 пользователей. В течение недели компания показывала в новостной ленте некоторых юзеров либо только положительную информацию, либо только отрицательную. Так в Facebook пытались узнать, как пользователи реагируют на позитив и негатив и что поможет увеличить их активность. Формально соцсеть не нарушила политику использования данных, но фактически она сознательно корректировала настроение пользователей без их ведома.

Эмоции пользователей — ценный актив для Facebook, которым соцсеть смело распоряжается, проводя подобные эксперименты и используя полученные данные для создания такой контентной политики, которая направлена на формирование зависимости от соцсети.

«Жадность» до пользовательских данных

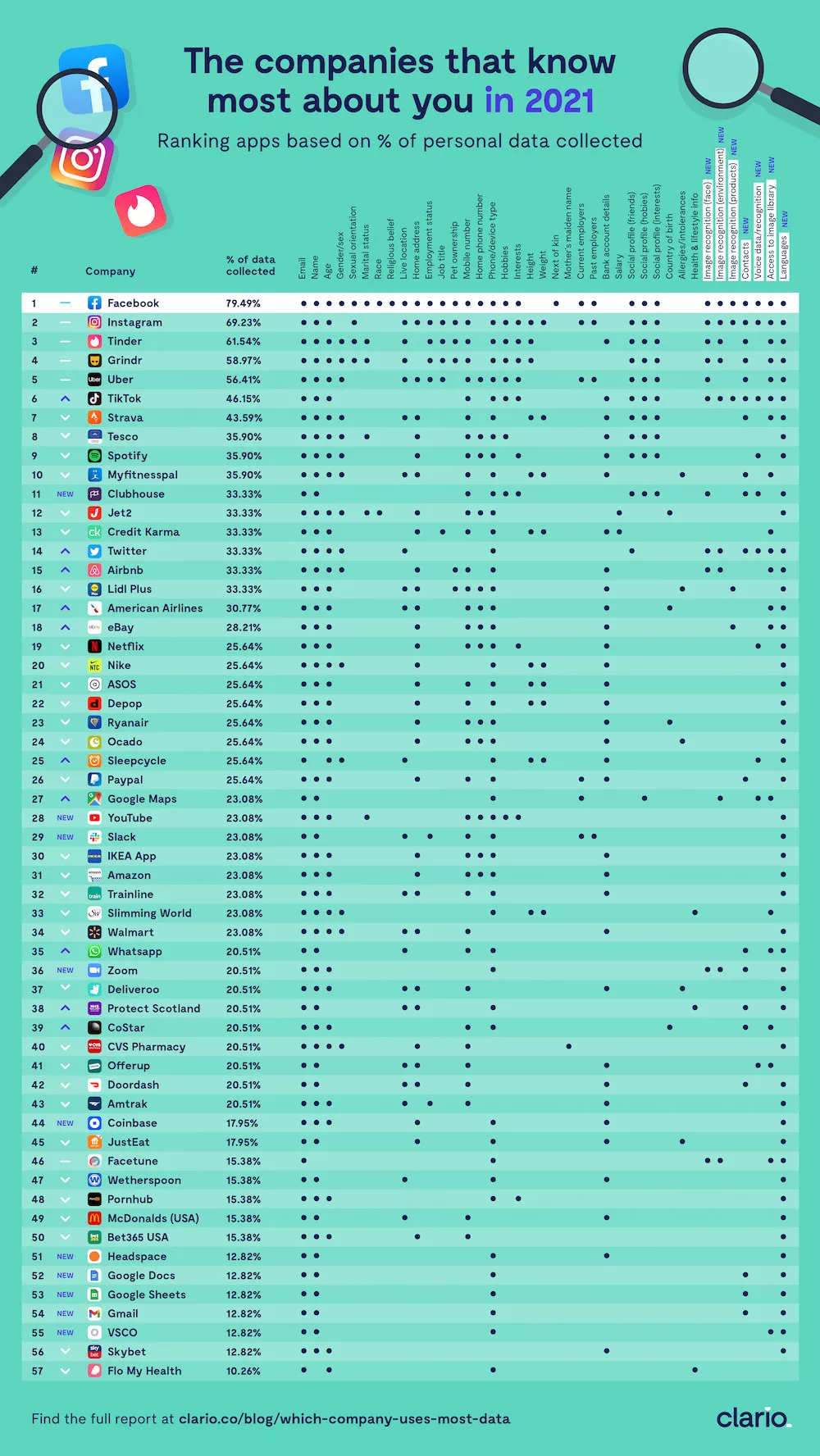

Исследовательская компания Clario опубликовала список компаний, которые собирают больше всех данных о пользователях: на первом месте Facebook (сюрприз!). Социальную сеть интересует всё: от адреса электронной почты до информации о домашнем питомце. На втором месте Instagram, через который Facebook собирает дополнительные данные, например, рост и вес.

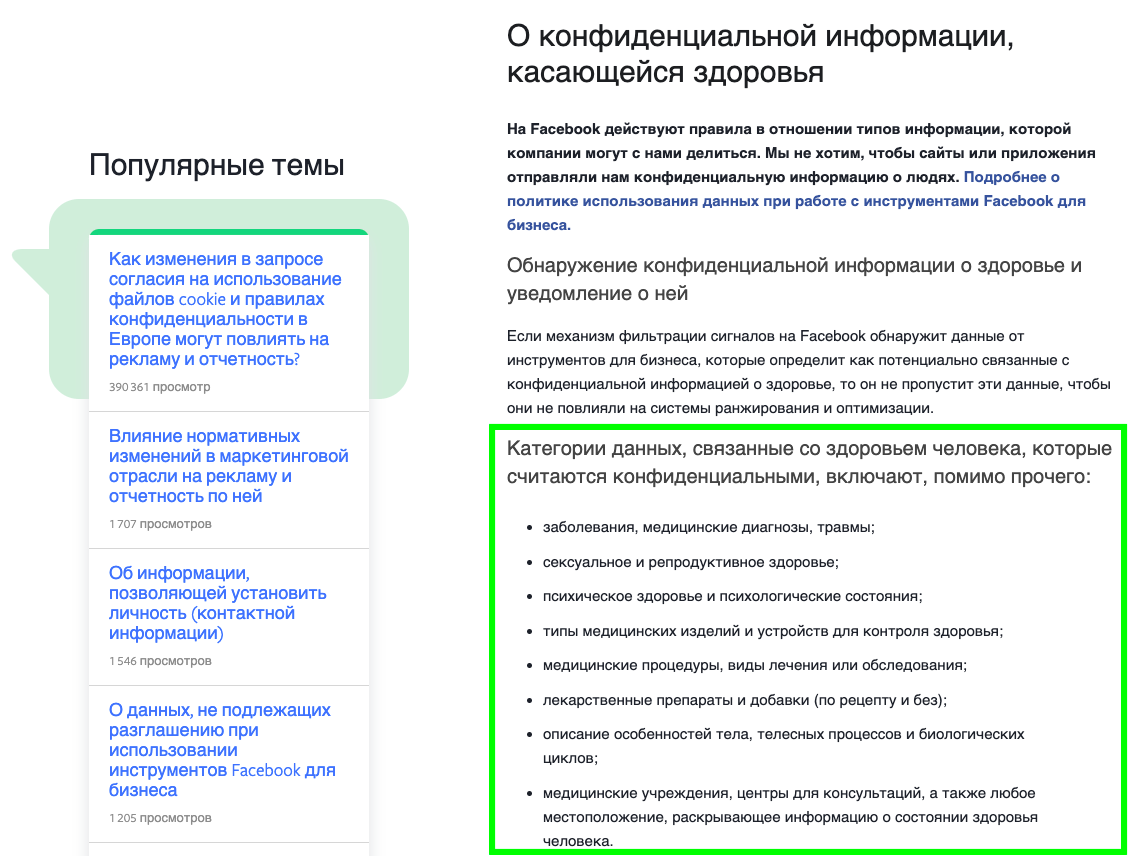

Косвенно Facebook собирает даже ту информацию о пользователе, которой якобы не интересуется. Например, компания утверждает, что данные о здоровье юзера являются конфиденциальным. Однако некоммерческая организация The Markup опубликовала отчёт, согласно которому Facebook отслеживает, про какие заболевания читают пользователи, чтобы превратить эту информацию в прибыльную персонализированную рекламу.

Механизм действия такой: люди распределяются по категориям интересов на основе их активности в Facebook, включая страницы, которые им нравятся, или объявления, на которые они нажимают. Эти данные позволяют фармацевтическим компаниям показывать рекламу лекарств тем пользователям, которых интересует информация о конкретной болезни.

В этой ситуации возникают сразу две проблемы, даже если формально Facebook не нарушает политики конфиденциальности. Во-первых, на пользователя может психологически давить информация, связанная с болезнью, а постоянно всплывающая реклама лекарств — угнетать. Во-вторых, возникает вопрос о защите личных данных, которые Facebook использует неочевидными способами и монетизирует.

Непрозрачная политика и несдержанные обещания

На фоне многочисленных обвинений в дезинформации, негативном влиянии на пользователей, продвижении жесткого контента Facebook объявил о запуске кампании для восстановления имиджа. Программа под названием Project Amplify предполагает продвижение Facebook в новостной ленте соцсети. Решение вызвало неоднозначную реакцию, так как Facebook ранее не позиционировал ленту новостей как место, где он укрепляет репутацию.

И пока Facebook работает над собственным образом, он решил заодно сокращать доступ к данным, которые позволяли ученым и журналистам изучать, как работает соцсеть. Таким образом, полную картину о своей работе знает только Facebook, из-за этого уровень доверия людей постепенно снижается.

Усугубляется ситуация обещаниями, которые не сдерживает Facebook. Например, когда в 2014 году компания купила WhatsApp, она заверила пользователей, что не будет собирать данные из мессенджера. Но в 2021 году WhatsApp объявил, что будет обмениваться пользовательскими данными с Facebook. Ева Гальперин, директор по кибербезопасности группы по цифровым правам EFF, отреагировала на новость ироничным твитом: «Эй, помните, когда Facebook купил WhatsApp и поклялся, что они не будут этого делать? Сюрприз!»

Модераторы буквально сходят с ума

Пользователи обычно не видят результатов работы модераторов, потому что их задача — удалить потенциально опасный контент. Facebook нанимает тысячи модераторов, показывая, что заботится о пользователях, оберегает их от жестокой информации в соцсети. Однако о сотрудниках, которые каждый день просматривают и удаляют травмирующий контент, компания не заботится. Это подтверждает исследование The Verge, опубликованное в 2019 году. Материал основан на серии интервью с бывшими модераторами Facebook, которые нарушили соглашение о неразглашении.

Один из сотрудников рассказал о модераторе по имени Кит Аттл. Регулярный стресс, невозможность поделиться с кем-либо информацией о работе давили на него. Постоянное напряжение сказалось на здоровье: 9 марта 2018 года он умер на рабочем месте от сердечного приступа.

После инцидента компания пообещала внести изменения для создания психологически комфортных условий работы.

Однако в 2021 году американский журнал Vice выложил интервью с бывшим модератором Facebook. Он рассказал про конвейер жестоких публикаций, которые нужно просматривать быстро. На принятие сложных моральных решений об удалении публикации есть всего несколько секунд.

По словам сотрудника, Facebook не учитывает, насколько опасна для ментального здоровья работа модератора. В штате отсутствуют специалисты по оказанию психологической поддержки. В результате после увольнения из компании у героя интервью диагностировали посттравматическое стрессовое расстройство (такой же диагноз ставят некоторым солдатам, служившим в горячих точках). И это не единичный случай, когда Facebook пренебрегает психическим здоровьем своих работников.

Цитата из интервью: «Они (прим. ред. разработчики Facebook) даже не понимают, что происходит (прим. ред. с модераторами)»

Фабрика фейков

Facebook регулярно подвергается критике за распространение фейковой информации. В 2016 году компанию обвиняли в том, что она сделала недостаточно для того, чтобы ограничить распространение фейковых новостей во время президентских выборов в США. В 2021 американский президент Джо Байден сказал, что Facebook «Убивает людей»: по мнению политика, соцсеть не борется с дезинформацией о вакцинации против коронавируса.

Пресс-секретарь Facebook Кевин Макалистер в ответ на обвинение заявил, что компания «не будет отвлекаться на обвинения, которые не подкреплены фактами».

«Мы удалили более 18 миллионов единиц дезинформации о Covid-19 удалили учетные записи, которые неоднократно нарушали эти правила», — говорится в заявлении компании.

Эксперименты с выборами

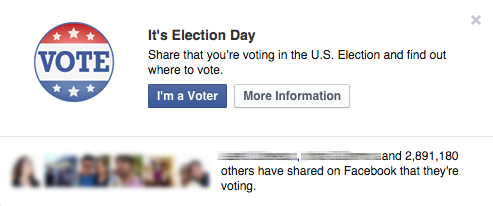

В 2010 году перед выборами в Конгресс США некоторые пользователи Facebook увидели в ленте новостей публикацию, которая предлагала принять участие в выборах и проголосовать.

На первый взгляд может показаться, что это безобидная электронная версия наклейки «Я проголосовал», которую американцы получают на выходе с избирательного участка. Facebook говорил, что он просто выполняет гражданский долг, поощряя пользователей голосовать.

Но, как сообщает Vox, дело не только в гражданском долге. Facebook проводил серию экспериментов над пользователями, чтобы понять, может ли это повысить вероятность проголосовать. В результате одна кнопка «убедила» проголосовать ещё 340 000 человек. Эксперимент Facebook — это не безобидное исследование, а манипуляция поведением избирателей и вмешательство в политическую реальность.

Подводя итог

Facebook, который регулярно фигурирует в скандалах, называют машиной судного дня. Социальную сеть, первоначальной целью которой было объединение людей по всему миру, обвиняют в распространении ложной информации, идей расизма и ненависти.

Справедливо будет заметить, что Facebook демонизируют намного активнее, чем не менее популярные Google или Twitter. Создатели Facebook признают, что им сложно контролировать все последствия глобального распространения социальной сети, но они уже работают над устранением некоторых проблем. К чему это приведёт — покажет время.

Как работают алгоритмы магазинов прил, почему одни продукты оказывают в топе, а другие никак до него не доберутся? Виноваты ли в этом плохие отзывы или агрессивный дизайн, маленький бюджет на продвижение или плохо собранная семантика? Разбираемся в «дьявольских» деталях ASO-продвижения с ребятами из команды iRent!